Prompt Engineering教程

Prompt Engineering中的“最少到最多提示过程”是什么?

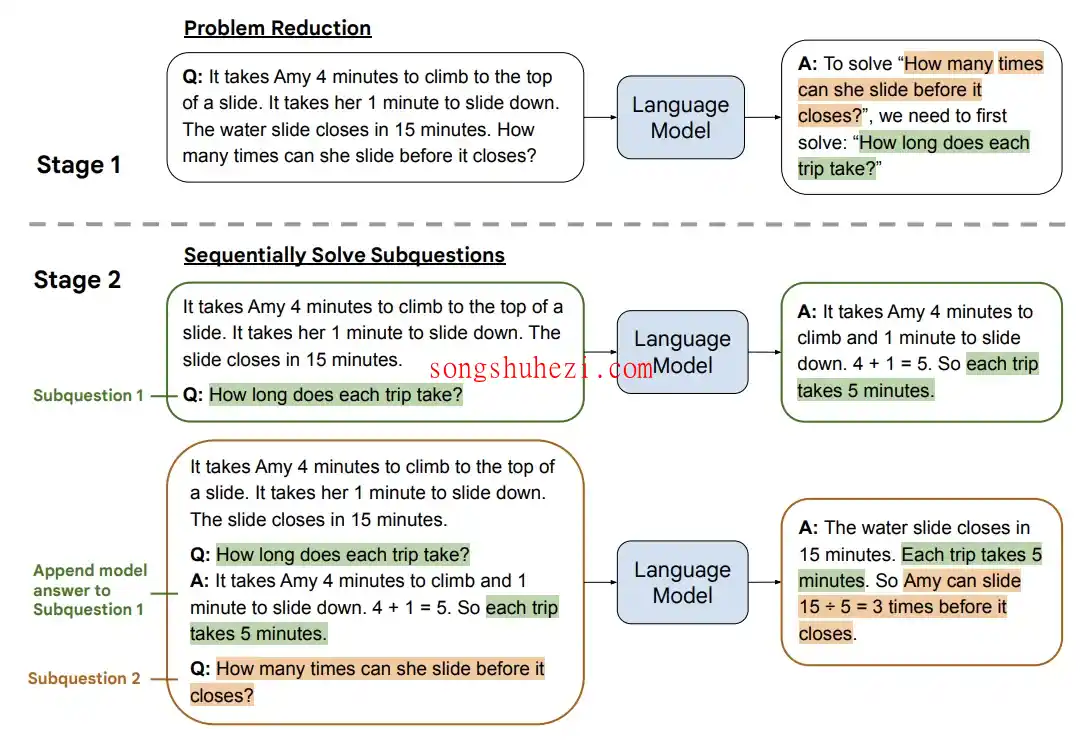

「最少到最多提示过程」(Least to Most prompting, LtM)是一个将问题分解为更小、更易管理的子问题,并逐一解决这些子问题的方法。这种策略的灵感来源于现实世界中对儿童的教学方法,它强调通过分步骤逐渐增加难度的方式来解决问题。

与传统的思维链提示(Chain of Thought prompting)相比,LtM不仅仅是分解问题,而是在解决每个子问题时,将前一个子问题的解决方案作为输入,帮助解决下一个子问题。

这种方法的有效性在于它的逐步逼近策略,允许大型语言模型(LLM)更加精确地处理复杂的问题。通过这种分步解决方案,LtM可以提高问题解决的准确率,尤其是在面对需要多步骤推理的复杂问题时。

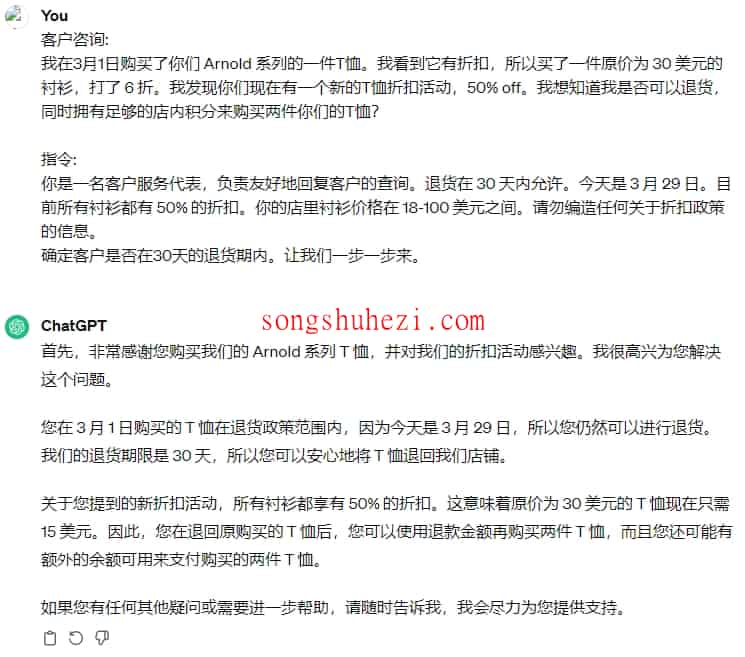

客户咨询问题

考虑一个客户服务场景,客户询问是否可以退货并用退款购买打折商品。在这种情况下,LtM方法首先识别出需要解决的子问题,例如确认退货政策、计算可能的退款金额、比较当前商品价格等。然后,逐一解决这些子问题,并将每个子问题的解答作为下一步的输入信息,最终形成一个完整的、合理的回答。

客户咨询:

我在3月1日购买了你们 Arnold 系列的一件T恤。我看到它有折扣,所以买了一件原价为 30 美元的衬衫,打了 6 折。我发现你们现在有一个新的T恤折扣活动,50% off。我想知道我是否可以退货,同时拥有足够的店内积分来购买两件你们的T恤?

指令:

你是一名客户服务代表,负责友好地回复客户的查询。退货在 30 天内允许。今天是 3 月 29 日。目前所有衬衫都有 50% 的折扣。你的店里衬衫价格在 18-100 美元之间。请勿编造任何关于折扣政策的信息。

确定客户是否在30天的退货期内。让我们一步一步来。

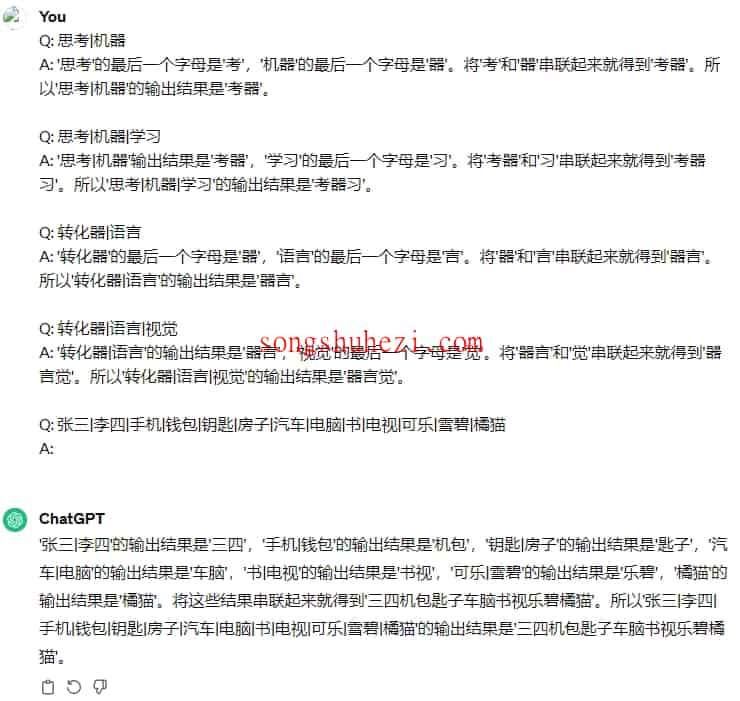

字符串连接问题

另一个例子是字符串连接问题,要求从给定的词语中提取最后一个字符并将它们连接起来。LtM通过首先识别出需要连接的字符,然后逐步将它们组合起来,直到形成最终的字符串。这种方法的优势在于,通过逐步增加信息,LLM能够更好地理解和执行任务,从而提高准确率。

Q: 思考|机器

A: '思考'的最后一个字母是'考','机器'的最后一个字母是'器'。将'考'和'器'串联起来就得到'考器'。所以'思考|机器'的输出结果是'考器'。

Q: 思考|机器|学习

A: '思考|机器'输出结果是'考器','学习'的最后一个字母是'习'。将'考器'和'习'串联起来就得到'考器习'。所以'思考|机器|学习'的输出结果是'考器习'。

Q: 转化器|语言

A: '转化器'的最后一个字母是'器','语言'的最后一个字母是'言'。将'器'和'言'串联起来就得到'器言'。所以'转化器|语言'的输出结果是'器言'。

Q: 转化器|语言|视觉

A: '转化器|语言'的输出结果是'器言','视觉'的最后一个字母是'觉'。将'器言'和'觉'串联起来就得到'器言觉'。所以'转化器|语言|视觉'的输出结果是'器言觉'。

Q: 张三|李四|手机|钱包|钥匙|房子|汽车|电脑|书|电视|可乐|雪碧|橘猫

A:

结论与优势

LtM方法的核心优势在于其逐步解决问题的能力,这不仅有助于提高问题解决的准确性,也使得模型能够更好地处理复杂性高的问题。此外,通过模仿人类解决问题的自然过程,LtM提升了模型的泛化能力,特别是在面对新问题或未在训练数据中直接出现的问题类型时。

阅读全文

×

初次访问:反爬虫,人机识别