DeepSpeed:深度加速大模型训练与推理

重塑大规模AI训练与部署

直达下载

返回上一页

描述

DeepSpeed助力大规模模型的训练与推理,提高AI应用的速度和规模。

介绍

DeepSpeed是一个由微软开发的深度学习优化库,专为大规模模型训练与推理设计。它不仅简化了分布式训练和推理的过程,还大幅提升了效率和效果。本文将详细探讨DeepSpeed的关键功能、最新动态以及如何在实际场景中应用DeepSpeed来加速AI模型的训练与推理。

DeepSpeed最新动态

- 2024年3月:推出DeepSpeed-FP6,专注于为大型语言模型提供FP6中心化服务,显著提升服务效能。

- 2024年1月:DeepSpeed-FastGen引入Mixtral, Phi-2, 和 Falcon支持,进一步增强性能和功能。

- 2023年11月:在第四代Intel® Xeon® 可扩展处理器上实现Llama 2推理,通过DeepSpeed实现显著的性能提升。

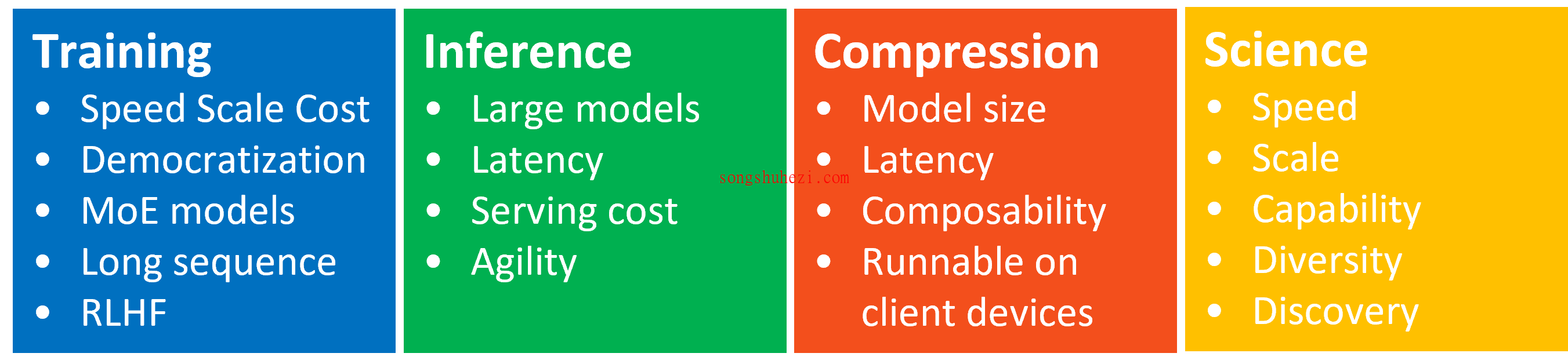

深度加速训练:DeepSpeed-Training

DeepSpeed通过系统创新(如ZeRO、3D-Parallelism等)极大地提升了大规模深度学习训练的效率和易用性,重新定义了可能达到的训练规模。

深度加速推理:DeepSpeed-Inference

DeepSpeed将并行技术和高性能推理内核结合,支持前所未有的推理规模,同时实现极低延迟和高吞吐量,显著降低成本。

深度加速压缩:DeepSpeed-Compression

DeepSpeed提供易于使用的模型压缩技术,帮助研究人员和实践者在保持较快速度和较小模型大小的同时,显著降低压缩成本。

科学加速:DeepSpeed4Science

通过AI系统技术创新,DeepSpeed4Science倡议旨在帮助领域专家解锁当今最大的科学难题。

在Azure上使用DeepSpeed

推荐在Azure上使用DeepSpeed,这是最简单的方法。用户可以通过AzureML配方轻松部署和运行DeepSpeed。

DeepSpeed的广泛应用

DeepSpeed已被广泛应用于训练多种大规模模型,包括Megatron-Turing NLG(530B)、BLOOM(176B)等,是微软“AI at Scale”倡议的重要组成部分。

×

直达下载

×

初次访问:反爬虫,人机识别